Множественная линейная регрессия — это статистический метод, который мы можем использовать для понимания взаимосвязи между несколькими переменными-предикторами и переменной- откликом .

Однако, прежде чем мы выполним множественную линейную регрессию, мы должны сначала убедиться, что выполняются пять допущений:

1. Линейная зависимость. Существует линейная зависимость между каждой переменной-предиктором и переменной отклика.

2. Отсутствие мультиколлинеарности. Ни одна из переменных-предикторов не сильно коррелирует друг с другом.

3. Независимость: наблюдения независимы.

4. Гомоскедастичность: остатки имеют постоянную дисперсию в каждой точке линейной модели.

5. Многомерная нормальность: остатки модели нормально распределены.

Если одно или несколько из этих предположений нарушены, то результаты множественной линейной регрессии могут быть ненадежными.

В этой статье мы даем объяснение каждому допущению, как определить, выполняется ли допущение, и что делать, если допущение нарушается.

Допущение 1: линейная зависимость

Множественная линейная регрессия предполагает наличие линейной связи между каждой переменной-предиктором и переменной-ответом.

Как определить, выполняется ли это предположение

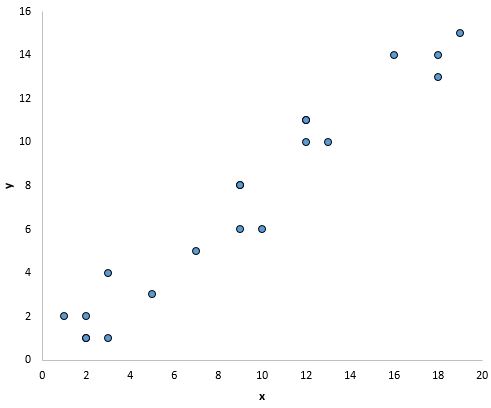

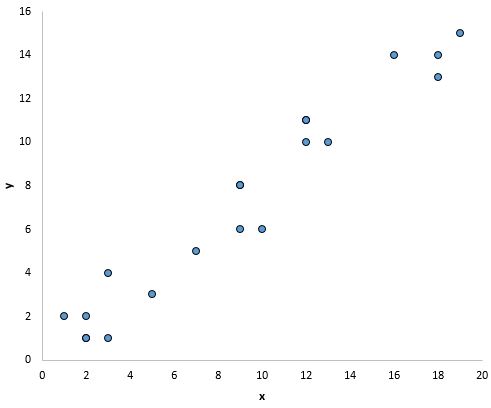

Самый простой способ определить, выполняется ли это предположение, — создать диаграмму рассеяния для каждой переменной-предиктора и переменной-ответа.

Это позволяет визуально увидеть, существует ли линейная зависимость между двумя переменными.

Если точки на точечной диаграмме примерно лежат на прямой диагональной линии, то, вероятно, существует линейная зависимость между переменными.

Например, точки на графике ниже выглядят так, как будто они падают примерно на прямую линию, что указывает на наличие линейной зависимости между этой конкретной переменной-предиктором (x) и переменной-откликом (y):

Что делать, если это предположение нарушается

Если между одной или несколькими переменными-предикторами и переменной ответа нет линейной зависимости, то у нас есть пара вариантов:

1. Примените нелинейное преобразование к переменной предиктора, например, извлеките логарифм или квадратный корень. Это часто может сделать отношения более линейными.

2. Добавьте в модель еще одну предикторную переменную. Например, если график зависимости x от y имеет параболическую форму, может иметь смысл добавить в модель X 2 в качестве дополнительной переменной-предиктора.

3. Удалите предикторную переменную из модели. В самом крайнем случае, если не существует линейной связи между определенной переменной-предиктором и переменной отклика, тогда переменная-предиктор может быть бесполезной для включения в модель.

Предположение 2: отсутствие мультиколлинеарности

Множественная линейная регрессия предполагает, что ни одна из переменных-предикторов не сильно коррелирует друг с другом.

Когда одна или несколько переменных-предикторов сильно коррелированы, регрессионная модель страдает от мультиколлинеарности , из-за чего оценки коэффициентов в модели становятся ненадежными.

Как определить, выполняется ли это предположение

Самый простой способ определить, выполняется ли это предположение, — вычислить значение VIF для каждой переменной-предиктора.

Значения VIF начинаются с 1 и не имеют верхнего предела. Как правило, значения VIF выше 5* указывают на потенциальную мультиколлинеарность.

В следующих руководствах показано, как рассчитать VIF в различных статистических программах:

* Иногда вместо этого исследователи используют значение VIF, равное 10, в зависимости от области исследования.

Что делать, если это предположение нарушается

Если одна или несколько переменных-предикторов имеют значение VIF больше 5, самый простой способ решить эту проблему — просто удалить переменные-предикторы с высокими значениями VIF.

В качестве альтернативы, если вы хотите сохранить каждую предикторную переменную в модели, вы можете использовать другой статистический метод, например гребневую регрессию , лассо-регрессию или частичную регрессию наименьших квадратов , предназначенную для обработки предикторных переменных с высокой степенью корреляции.

Допущение 3: Независимость

Множественная линейная регрессия предполагает, что каждое наблюдение в наборе данных является независимым.

Как определить, выполняется ли это предположение

Самый простой способ определить, выполняется ли это предположение, — выполнить тест Дарбина-Ватсона , формальный статистический тест, который сообщает нам, демонстрируют ли остатки (и, следовательно, наблюдения) автокорреляцию.

Что делать, если это предположение нарушается

В зависимости от характера нарушения этого предположения у вас есть несколько вариантов:

- Для положительной последовательной корреляции рассмотрите возможность добавления в модель лагов зависимой и/или независимой переменной.

- Для отрицательной последовательной корреляции убедитесь, что ни одна из ваших переменных не является сверхдифференциальной .

- Для сезонной корреляции рассмотрите возможность добавления в модель сезонных фиктивных переменных .

Допущение 4: гомоскедастичность

Множественная линейная регрессия предполагает, что остатки имеют постоянную дисперсию в каждой точке линейной модели. Когда это не так, говорят, что остатки страдают от гетероскедастичности .

Когда в регрессионном анализе присутствует гетероскедастичность, результаты регрессионной модели становятся ненадежными.

В частности, гетероскедастичность увеличивает дисперсию оценок коэффициента регрессии, но регрессионная модель этого не учитывает. Это повышает вероятность того, что регрессионная модель объявит термин в модели статистически значимым, хотя на самом деле это не так.

Как определить, выполняется ли это предположение

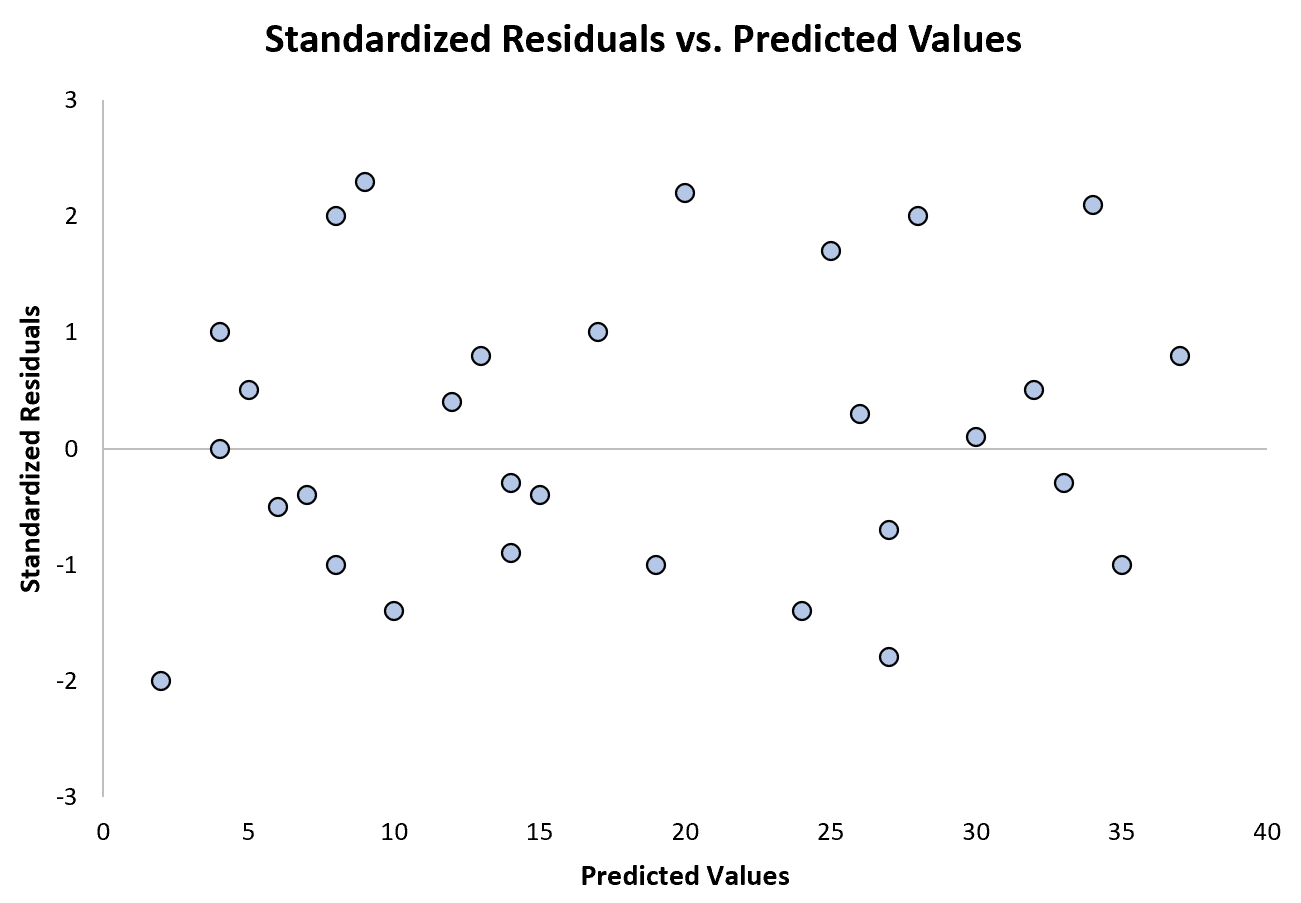

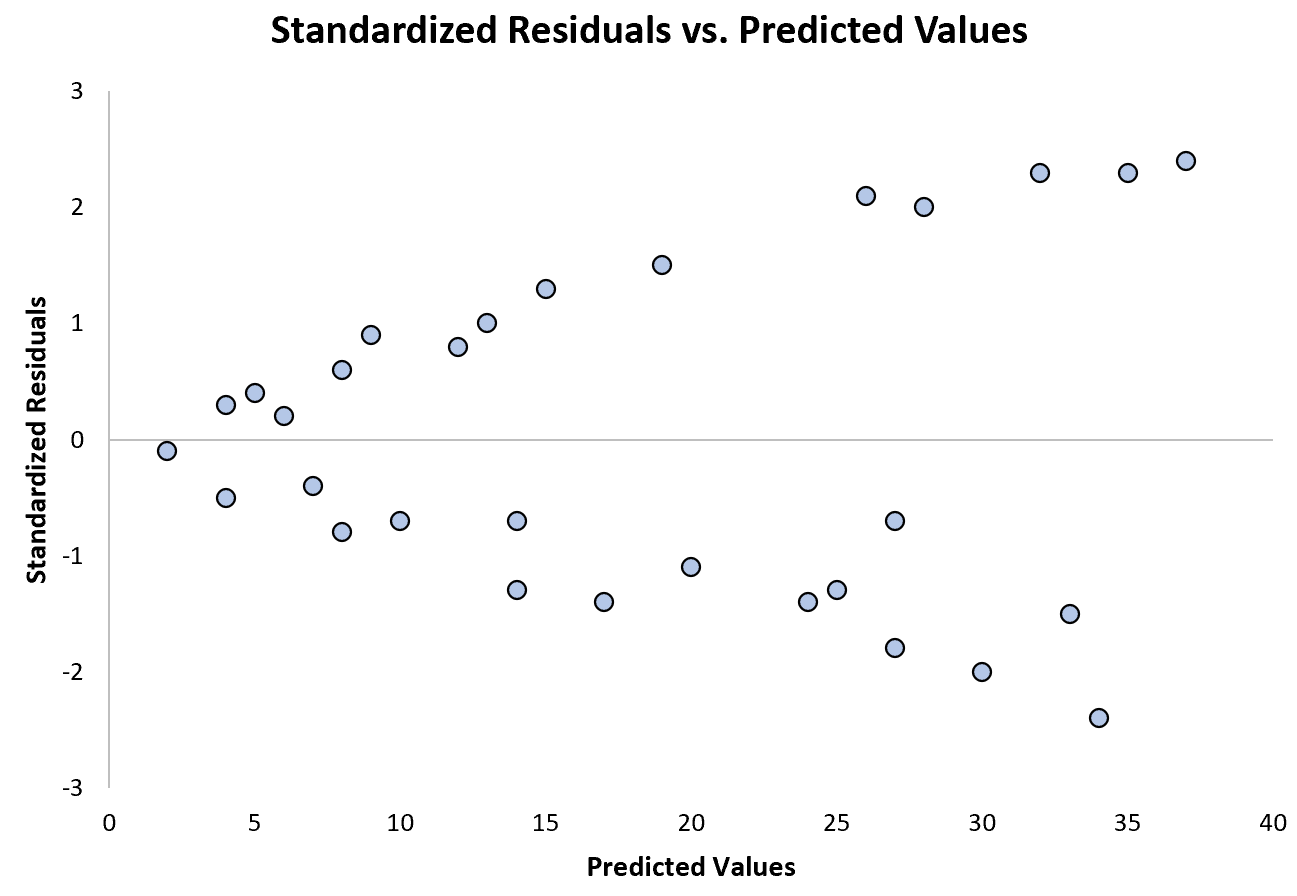

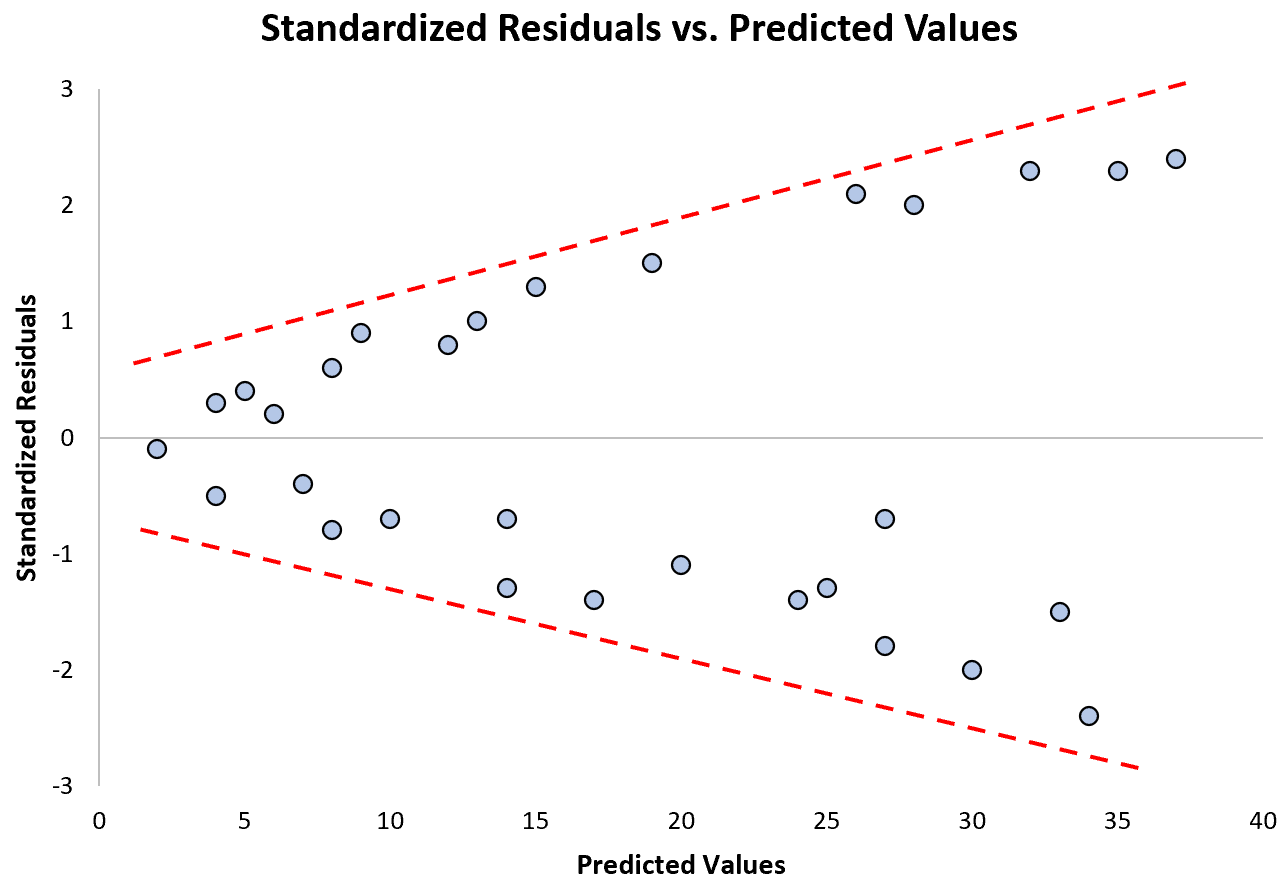

Самый простой способ определить, выполняется ли это предположение, — построить график стандартизированных остатков по сравнению с прогнозируемыми значениями.

После подбора регрессионной модели к набору данных вы можете создать точечную диаграмму, которая показывает прогнозируемые значения для переменной отклика на оси x и стандартизированные невязки модели на оси y.

Если точки на диаграмме рассеивания имеют закономерность, то присутствует гетероскедастичность.

На следующем графике показан пример регрессионной модели, в которой гетероскедастичность не является проблемой:

Обратите внимание, что стандартизированные остатки разбросаны около нуля без четкой закономерности.

На следующем графике показан пример регрессионной модели, в которой гетероскедастичность является проблемой:

Обратите внимание, как стандартизированные остатки становятся более разбросанными по мере того, как прогнозируемые значения становятся больше. Эта форма «конуса» — классический признак гетероскедастичности:

Что делать, если это предположение нарушается

Существует три распространенных способа исправить гетероскедастичность:

1. Преобразуйте переменную ответа. Самый распространенный способ справиться с гетероскедастичностью — преобразовать переменную отклика, взяв логарифмический, квадратный или кубический корень из всех значений переменной отклика. Это часто приводит к исчезновению гетероскедастичности.

2. Переопределите переменную ответа. Один из способов переопределить переменную ответа — использовать скорость , а не необработанное значение. Например, вместо использования численности населения для прогнозирования количества цветочных магазинов в городе мы можем вместо этого использовать численность населения для прогнозирования количества цветочных магазинов на душу населения.

В большинстве случаев это снижает изменчивость, которая естественным образом возникает среди больших групп населения, поскольку мы измеряем количество цветочных магазинов на человека, а не простое количество цветочных магазинов.

3. Используйте взвешенную регрессию. Другой способ исправить гетероскедастичность — использовать взвешенную регрессию, которая присваивает вес каждой точке данных на основе дисперсии ее подобранного значения.

По сути, это дает небольшие веса точкам данных с более высокой дисперсией, что уменьшает их квадраты невязок. Когда используются правильные веса, это может устранить проблему гетероскедастичности.

Связанный : Как выполнить взвешенную регрессию в R

Допущение 4: Многомерная нормальность

Множественная линейная регрессия предполагает, что остатки модели нормально распределены.

Как определить, выполняется ли это предположение

Есть два распространенных способа проверить, выполняется ли это предположение:

1. Проверьте предположение визуально, используя графики QQ .

График QQ, сокращение от графика квантилей-квантилей, представляет собой тип графика, который мы можем использовать, чтобы определить, следуют ли остатки модели нормальному распределению. Если точки на графике примерно образуют прямую диагональную линию, то предположение о нормальности выполнено.

На следующем графике QQ показан пример остатков, которые примерно соответствуют нормальному распределению:

Однако на приведенном ниже графике QQ показан пример, когда остатки явно отклоняются от прямой диагональной линии, что указывает на то, что они не следуют нормальному распределению:

2. Проверьте предположение с помощью формального статистического теста, например Шапиро-Уилка, Колмогорова-Смиронова, Жака-Барре или Д'Агостино-Пирсона.

Имейте в виду, что эти тесты чувствительны к большим размерам выборки, то есть они часто заключают, что остатки не являются нормальными, когда размер вашей выборки чрезвычайно велик. Вот почему часто проще использовать графические методы, такие как график QQ, для проверки этого предположения.

Что делать, если это предположение нарушается

Если предположение о нормальности нарушается, у вас есть пара вариантов:

1. Во-первых, убедитесь, что в данных нет экстремальных выбросов, которые нарушают допущение о нормальности.

2. Затем вы можете применить нелинейное преобразование к переменной ответа, например, извлечение квадратного корня, логарифмического или кубического корня из всех значений переменной ответа. Это часто приводит к более нормальному распределению остатков модели.

Дополнительные ресурсы

Следующие руководства содержат дополнительную информацию о множественной линейной регрессии и ее предположениях:

Введение в множественную линейную регрессию

Руководство по гетероскедастичности в регрессионном анализе

Руководство по мультиколлинеарности и VIF в регрессии

В следующих руководствах представлены пошаговые примеры выполнения множественной линейной регрессии с использованием различных статистических программ:

Как выполнить множественную линейную регрессию в Excel

Как выполнить множественную линейную регрессию в R

Как выполнить множественную линейную регрессию в SPSS

Как выполнить множественную линейную регрессию в Stata